如何运行java爬虫

运行Java爬虫的方法

准备开发环境

确保已安装JDK(建议JDK 8或更高版本)和IDE(如IntelliJ IDEA或Eclipse)。配置Maven或Gradle管理依赖(若使用第三方库)。

添加爬虫依赖

在pom.xml(Maven)或build.gradle(Gradle)中添加爬虫库,例如Jsoup或WebMagic:

<!-- Jsoup示例 -->

<dependency>

<groupId>org.jsoup</groupId>

<artifactId>jsoup</artifactId>

<version>1.15.3</version>

</dependency>编写爬虫代码

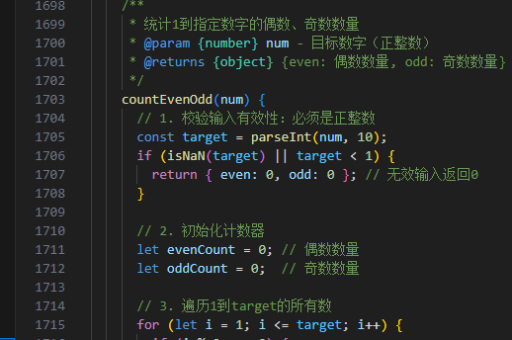

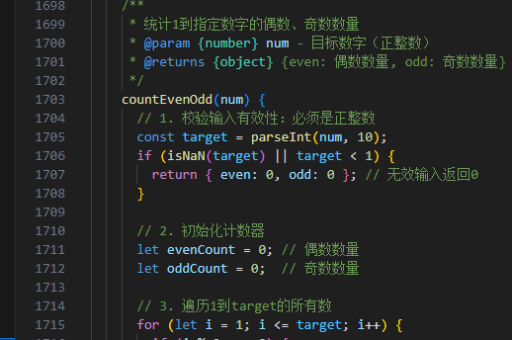

使用Jsoup抓取网页并解析数据的简单示例:

import org.jsoup.Jsoup;

import org.jsoup.nodes.Document;

import java.io.IOException;

public class SimpleCrawler {

public static void main(String[] args) {

try {

Document doc = Jsoup.connect("https://example.com").get();

String title = doc.title();

System.out.println("网页标题: " + title);

} catch (IOException e) {

e.printStackTrace();

}

}

}处理动态内容

若页面依赖JavaScript渲染,需使用Selenium等工具:

import org.openqa.selenium.WebDriver;

import org.openqa.selenium.chrome.ChromeDriver;

public class DynamicCrawler {

public static void main(String[] args) {

System.setProperty("webdriver.chrome.driver", "chromedriver路径");

WebDriver driver = new ChromeDriver();

driver.get("https://example.com");

System.out.println("动态页面标题: " + driver.getTitle());

driver.quit();

}

}存储数据

将抓取的数据保存至文件或数据库:

import java.io.FileWriter;

import java.io.IOException;

public class DataStorage {

public static void saveToFile(String data, String filename) {

try (FileWriter writer = new FileWriter(filename)) {

writer.write(data);

} catch (IOException e) {

e.printStackTrace();

}

}

}遵守爬虫规范

设置合理请求间隔(如Thread.sleep(1000)),添加User-Agent头部,避免触发反爬机制:

Document doc = Jsoup.connect(url)

.userAgent("Mozilla/5.0")

.timeout(5000)

.get();运行与调试

通过IDE直接运行或打包为JAR后执行:

java -jar your-crawler.jar