longblob如何入库JAVA

使用JDBC将LongBlob存入MySQL数据库

在Java中,可以通过JDBC API将LongBlob类型数据存入MySQL数据库。需要创建PreparedStatement并使用setBinaryStream或setBlob方法。

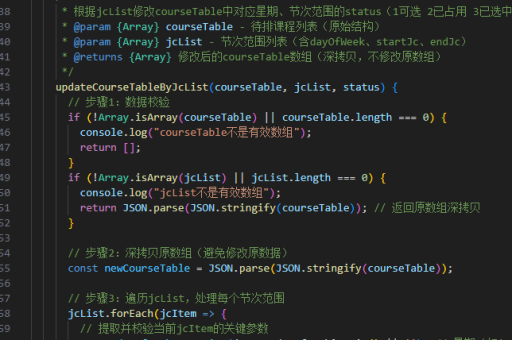

// 假设已经获取了数据库连接Connection conn

File file = new File("path/to/your/file.dat");

InputStream inputStream = new FileInputStream(file);

String sql = "INSERT INTO your_table (blob_column) VALUES (?)";

PreparedStatement pstmt = conn.prepareStatement(sql);

pstmt.setBinaryStream(1, inputStream, (int)file.length());

pstmt.executeUpdate();使用Hibernate处理LongBlob

使用Hibernate框架时,可以通过@Lob注解映射LongBlob字段。实体类中应使用byte[]类型表示二进制数据。

@Entity

@Table(name = "your_table")

public class YourEntity {

@Id

@GeneratedValue(strategy = GenerationType.IDENTITY)

private Long id;

@Lob

private byte[] fileData;

// getters and setters

}使用Spring JPA存储LongBlob

Spring Data JPA中处理LongBlob的方式与Hibernate类似。Repository接口会自动处理Lob类型的持久化。

public interface YourRepository extends JpaRepository<YourEntity, Long> {

// 自动支持Lob类型的CRUD操作

}

// 使用示例

YourEntity entity = new YourEntity();

entity.setFileData(Files.readAllBytes(Paths.get("path/to/file")));

yourRepository.save(entity);处理大文件的分块上传

对于特别大的文件,建议分块上传以避免内存问题。可以使用JDBC的setBinaryStream方法结合流式处理。

try (Connection conn = dataSource.getConnection();

InputStream is = new FileInputStream(largeFile);

PreparedStatement pstmt = conn.prepareStatement(

"INSERT INTO large_files (file_name, content) VALUES (?, ?)")) {

pstmt.setString(1, largeFile.getName());

pstmt.setBinaryStream(2, is);

pstmt.executeUpdate();

}性能优化建议

设置JDBC连接参数提高大对象传输效率:

- 使用

rewriteBatchedStatements=true参数优化批量插入 - 调整

max_allowed_packetMySQL服务器参数以适应大文件 - 考虑使用连接池配置合适的连接超时时间

# application.properties示例配置

spring.datasource.url=jdbc:mysql://localhost:3306/db?useSSL=false&rewriteBatchedStatements=true

spring.datasource.hikari.connection-timeout=30000