学java如何转大数据

学习路径规划

Java作为大数据生态系统的核心语言之一,是转向大数据领域的优势基础。掌握Hadoop、Spark等框架的Java API,并补充分布式计算、数据存储等知识是关键。

核心技能提升

大数据基础技术栈包括Hadoop、Spark、Flink等分布式计算框架。Hadoop的MapReduce原生支持Java,Spark也提供Java API。深入学习这些框架的架构和编程模型,例如RDD、DataFrame等概念。

分布式数据库如HBase、Cassandra通常使用Java客户端操作。理解其数据模型和访问模式,例如HBase的RowKey设计原则、Cassandra的CAP特性。

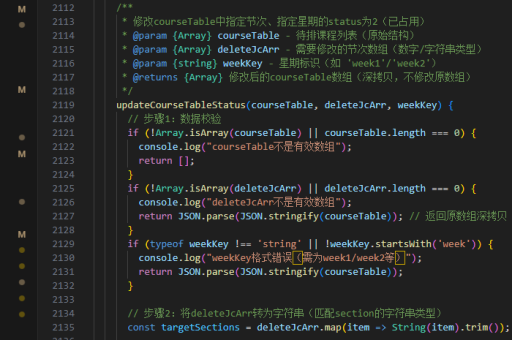

// Spark Java示例:单词计数

JavaRDD<String> textFile = sc.textFile("hdfs://path/to/file");

JavaRDD<String> words = textFile.flatMap(line -> Arrays.asList(line.split(" ")).iterator());

JavaPairRDD<String, Integer> counts = words.mapToPair(word -> new Tuple2<>(word, 1)).reduceByKey((a, b) -> a + b);生态工具掌握

消息队列Kafka使用Java开发,其生产者/消费者API需熟练掌握。序列化工具如Avro、Parquet的Java实现需要了解,包括Schema定义和数据读写操作。

资源调度工具YARN的应用程序开发涉及Java API。学习编写YARN ApplicationMaster和Container的逻辑,理解资源请求机制。

数据处理能力

掌握Java生态的数据处理库,如Algebird的抽象代数实现,JTransforms的FFT计算。对于机器学习,了解Mahout的Java算法库或Spark MLlib的Java接口。

ETL工具如Apache NiFi支持Java扩展开发。学习编写自定义Processor,实现数据流转逻辑。流处理方面,Flink的DataStream API需重点掌握窗口、状态等机制。

性能优化方向

JVM调优在大数据场景尤为重要。理解GC策略对长时间运行作业的影响,合理设置堆内存和Off-Heap内存。掌握序列化优化技巧,例如Kryo的使用。

分布式系统调试需要熟悉Java生态工具链,如Async Profiler分析性能瓶颈,Arthas进行运行时诊断。网络通信方面,Netty等框架的优化经验很有价值。

项目实践建议

从搭建伪分布式环境开始,使用Java编写完整的MapReduce作业。逐步实现Join、Sort等复杂操作,对比Spark实现差异。参与开源项目如Hadoop的JIRA任务,贡献Java代码补丁。

构建端到端数据处理管道是个综合实践方式。用Java实现Kafka生产者、Flink流处理、HBase存储的完整链路,加入监控和容错机制。云平台如AWS EMR的Java SDK开发经验也值得积累。