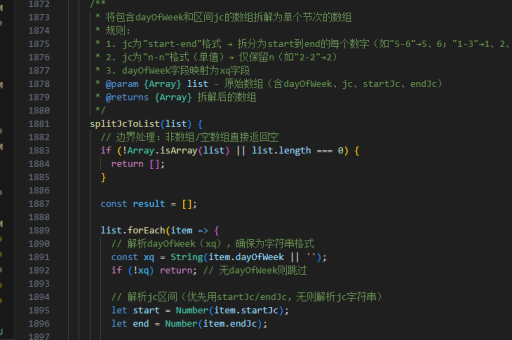

java 爬虫如何运行

Java 爬虫的运行步骤

准备开发环境

确保已安装JDK(Java Development Kit)和集成开发环境(如IntelliJ IDEA或Eclipse)。

添加必要的依赖库,例如Jsoup(用于HTML解析)或HttpClient(用于HTTP请求)。Maven项目中可在pom.xml中添加以下依赖:

<!-- Jsoup依赖 -->

<dependency>

<groupId>org.jsoup</groupId>

<artifactId>jsoup</artifactId>

<version>1.15.3</version>

</dependency>

<!-- HttpClient依赖 -->

<dependency>

<groupId>org.apache.httpcomponents</groupId>

<artifactId>httpclient</artifactId>

<version>4.5.13</version>

</dependency>发送HTTP请求

使用HttpClient或Jsoup发送GET/POST请求获取网页内容。示例代码:

import org.jsoup.Jsoup;

import org.jsoup.nodes.Document;

public class SimpleCrawler {

public static void main(String[] args) throws Exception {

String url = "https://example.com";

Document doc = Jsoup.connect(url).get();

System.out.println(doc.title());

}

}解析HTML内容

通过Jsoup选择器提取目标数据。例如获取页面中所有链接:

import org.jsoup.nodes.Element;

import org.jsoup.select.Elements;

Elements links = doc.select("a[href]");

for (Element link : links) {

System.out.println(link.attr("href"));

}处理动态内容(可选)

若页面依赖JavaScript渲染,需使用Selenium WebDriver或HtmlUnit等工具模拟浏览器行为。示例:

import org.openqa.selenium.WebDriver;

import org.openqa.selenium.chrome.ChromeDriver;

System.setProperty("webdriver.chrome.driver", "path/to/chromedriver");

WebDriver driver = new ChromeDriver();

driver.get("https://example.com");

String pageSource = driver.getPageSource();

driver.quit();数据存储

将爬取的数据保存到文件或数据库。例如使用FileWriter写入文本文件:

import java.io.FileWriter;

import java.io.IOException;

try (FileWriter writer = new FileWriter("output.txt")) {

writer.write(doc.html());

} catch (IOException e) {

e.printStackTrace();

}注意事项

- 遵守目标网站的

robots.txt协议,避免高频请求导致IP封禁。 - 设置合理的请求间隔(如

Thread.sleep(1000))以模拟人工操作。 - 处理异常情况(如超时、404错误)确保程序健壮性。

通过以上步骤,可完成一个基础的Java爬虫实现。根据需求扩展功能,如多线程爬取、代理IP支持等。