如何开发java算子

开发Java算子的基本流程

开发Java算子通常涉及设计、实现、测试和部署几个关键阶段。算子(Operator)在数据处理、流计算或分布式系统中指代可重用的计算单元,例如Flink、Spark等框架中的UDF(用户自定义函数)。

设计阶段

明确算子的功能需求和输入输出。例如,实现一个字符串处理的算子,需定义输入为字符串,输出为处理后结果(如长度、哈希值等)。设计时需考虑算子的并行度和状态管理(对有状态算子)。

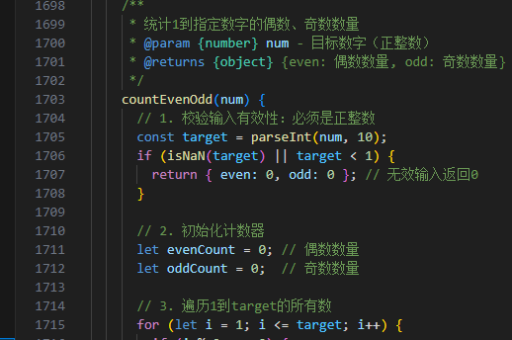

实现阶段

以Apache Flink为例,Java算子的核心是实现RichFunction接口(如RichMapFunction)。以下是一个简单的映射算子示例:

public class StringLengthMapper extends RichMapFunction<String, Integer> {

@Override

public Integer map(String value) {

return value.length();

}

}对于有状态算子,需通过RuntimeContext访问状态后端:

public class StatefulCounter extends RichFlatMapFunction<String, Tuple2<String, Integer>> {

private ValueState<Integer> counter;

@Override

public void open(Configuration parameters) {

ValueStateDescriptor<Integer> descriptor =

new ValueStateDescriptor<>("counter", Integer.class);

counter = getRuntimeContext().getState(descriptor);

}

@Override

public void flatMap(String input, Collector<Tuple2<String, Integer>> out) throws Exception {

Integer currentCount = counter.value() == null ? 1 : counter.value() + 1;

counter.update(currentCount);

out.collect(new Tuple2<>(input, currentCount));

}

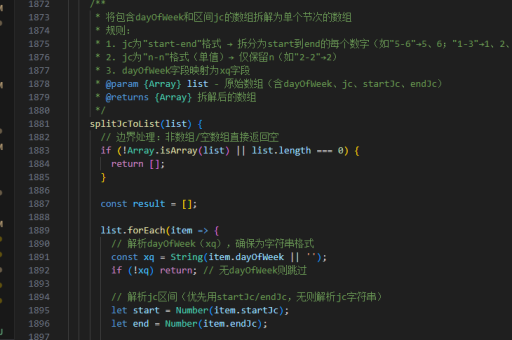

}测试阶段

使用JUnit进行单元测试。对于Flink算子,可用AbstractStreamOperatorTestHarness测试状态和计时逻辑:

@Test

public void testStatefulCounter() throws Exception {

StatefulCounter operator = new StatefulCounter();

AbstractStreamOperatorTestHarness<Tuple2<String, Integer>> testHarness =

new OneInputStreamOperatorTestHarness<>(operator);

testHarness.open();

testHarness.processElement(new StreamRecord<>("data1"));

testHarness.processElement(new StreamRecord<>("data1"));

assertEquals(2, operator.getRuntimeContext().getState(operator.counter).value());

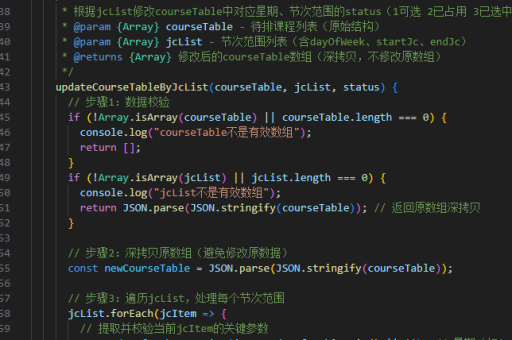

}部署阶段

打包算子为JAR文件并提交到运行环境。在Flink中,通过命令行或REST API提交作业:

flink run -c com.example.StreamJob ./target/operator.jar性能优化

- 减少序列化开销:使用POJO或基本类型而非复杂对象。

- 合理设置并行度:通过

setParallelism()调整。 - 状态优化:对大规模状态使用

RocksDBStateBackend。

错误处理

实现RichFunction的open()和close()方法管理资源。通过Collector报告错误或使用侧输出流(Side Output)处理异常数据:

OutputTag<String> errorTag = new OutputTag<String>("errors"){};

DataStream<String> errorStream = mainStream.getSideOutput(errorTag);版本兼容性

确保算子与目标框架版本匹配。例如,Flink 1.15的API可能与1.10存在差异,需参考官方迁移指南。