js实现分词

分词的基本概念

分词是指将连续的文本按照语义或规则切分成独立的词语或标记。在中文中,分词尤为重要,因为中文句子由连续的字组成,没有明显的分隔符。英文等语言的分词相对简单,通常以空格或标点符号分隔。

基于规则的分词方法

使用正则表达式或字符串方法实现简单的分词。这种方法适用于英文或结构简单的文本。

// 英文分词示例

const text = "This is a sample sentence.";

const words = text.split(/\s+/);

console.log(words); // ["This", "is", "a", "sample", "sentence."]

// 中文简单分词(按字分割)

const chineseText = "这是一个例子";

const chineseChars = chineseText.split('');

console.log(chineseChars); // ["这", "是", "一", "个", "例", "子"]基于字典的分词方法

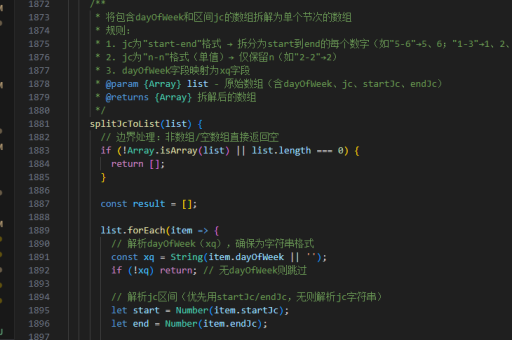

利用预定义的词典实现更准确的中文分词。常见算法包括正向最大匹配(FMM)和逆向最大匹配(RMM)。

// 正向最大匹配示例

function forwardMaxMatch(text, dict, maxLen) {

const result = [];

let i = 0;

while (i < text.length) {

let matched = false;

for (let l = Math.min(maxLen, text.length - i); l > 0; l--) {

const candidate = text.substr(i, l);

if (dict.has(candidate)) {

result.push(candidate);

i += l;

matched = true;

break;

}

}

if (!matched) {

result.push(text[i]);

i++;

}

}

return result;

}

const dict = new Set(["这是", "一个", "例子"]);

const text = "这是一个例子";

console.log(forwardMaxMatch(text, dict, 2)); // ["这是", "一个", "例子"]使用第三方库

许多成熟的JavaScript库可以实现高效分词,例如:

- nodejieba:中文分词库,基于C++实现,性能较高。

- jieba-js:纯JavaScript实现的中文分词库。

- natural:支持英文分词和自然语言处理的库。

// 使用jieba-js的示例

const { cut } = require('jieba-js');

const text = "这是一个例子";

const words = cut(text);

console.log(words); // ["这是", "一个", "例子"]基于机器学习的分词方法

利用预训练的模型(如CRF、BiLSTM-CRF)实现更智能的分词。通常需要加载模型文件或调用API。

// 使用TensorFlow.js加载预训练模型(示例代码)

async function loadModelAndSegment(text) {

const model = await tf.loadLayersModel('path/to/model.json');

// 预处理输入并调用模型

const result = model.predict(text);

return result;

}分词的应用场景

- 搜索引擎:提高搜索结果的准确性。

- 自然语言处理:为后续的文本分析提供基础。

- 文本挖掘:提取关键词或主题。

注意事项

- 中文分词的准确性高度依赖词典或模型的覆盖范围。

- 英文分词需处理标点符号和大小写问题。

- 复杂场景建议使用成熟的第三方库。