如何配置大模型react

配置大模型React的步骤

确保Node.js和npm/yarn已安装。React官方推荐使用Create React App或Vite作为项目脚手架。

使用Create React App初始化项目:

npx create-react-app my-large-model-app

cd my-large-model-app安装必要的依赖项,包括大模型相关的库如Transformers.js或LangChain:

npm install @xenova/transformers langchain集成大模型API

在React组件中导入并初始化大模型。以Transformers.js为例:

import { pipeline } from '@xenova/transformers';

async function loadModel() {

const classifier = await pipeline('text-classification', 'Xenova/bert-base-uncased');

const result = await classifier('This is a positive text');

console.log(result);

}使用useEffect钩子确保模型只在组件挂载时加载:

import { useEffect } from 'react';

function ModelComponent() {

useEffect(() => {

loadModel();

}, []);

}优化性能

大模型可能消耗大量资源,考虑以下优化措施:

实现懒加载,只在需要时加载模型:

const loadModel = async () => {

const { pipeline } = await import('@xenova/transformers');

return await pipeline('text-classification');

};使用Web Worker在后台线程运行模型推理,避免阻塞UI:

const worker = new Worker('./model.worker.js');

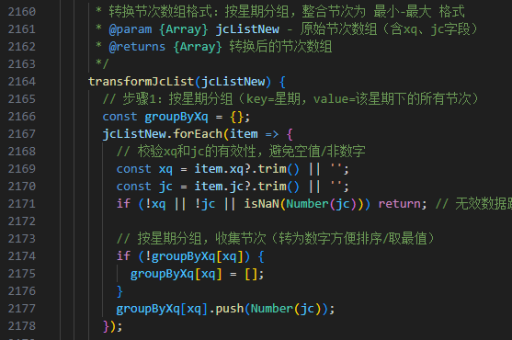

worker.postMessage({ text: 'Input text' });处理模型输出

将模型输出整合到React状态管理中:

const [output, setOutput] = useState(null);

async function handleInput(text) {

const result = await classifier(text);

setOutput(result);

}对于流式输出,可以使用React的状态更新:

const [streamingOutput, setStreamingOutput] = useState('');

function handleStream(chunk) {

setStreamingOutput(prev => prev + chunk);

}部署注意事项

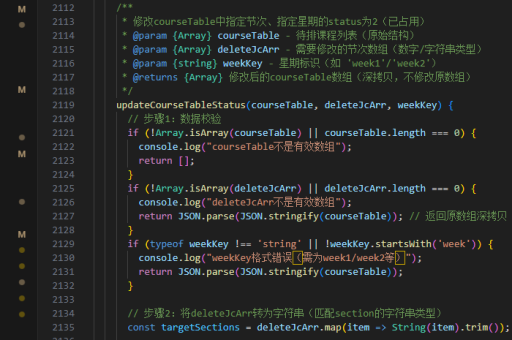

配置生产环境变量,隐藏API密钥:

# .env

REACT_APP_MODEL_API_KEY=your_api_key考虑使用CDN加载模型文件以减少打包体积:

const model = await pipeline('text-classification', {

model_url: 'https://cdn.example.com/models/bert-base-uncased'

});错误处理和用户体验

添加加载状态和错误处理:

const [isLoading, setIsLoading] = useState(false);

const [error, setError] = useState(null);

try {

setIsLoading(true);

const result = await classifier(input);

setOutput(result);

} catch (err) {

setError(err.message);

} finally {

setIsLoading(false);

}实现模型加载进度指示器:

const [progress, setProgress] = useState(0);

const classifier = await pipeline('text-classification', {

progress_callback: (progress) => {

setProgress(Math.round(progress * 100));

}

});