vue实现语音导航

语音识别与合成基础

在Vue中实现语音导航需要结合浏览器提供的Web Speech API,分为语音识别(SpeechRecognition)和语音合成(SpeechSynthesis)两部分。

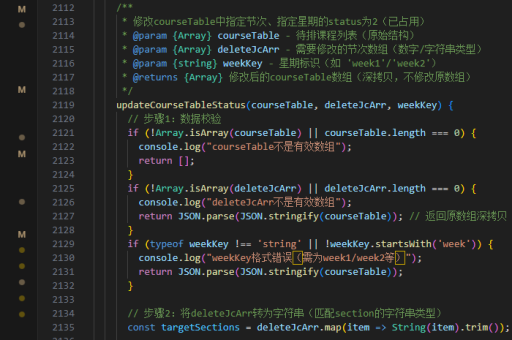

语音识别实现

-

初始化语音识别

创建语音识别实例并配置参数:const recognition = new (window.SpeechRecognition || window.webkitSpeechRecognition)(); recognition.lang = 'zh-CN'; // 设置语言为中文 recognition.interimResults = false; // 是否返回临时结果 -

监听识别结果

通过事件监听获取语音输入内容:recognition.onresult = (event) => { const transcript = event.results[0][0].transcript; console.log('识别结果:', transcript); // 触发导航逻辑 }; -

错误处理与启动/停止

添加错误监听和手动控制:recognition.onerror = (event) => { console.error('识别错误:', event.error); }; // 开始识别 recognition.start(); // 停止识别 recognition.stop();

语音合成实现

-

文本转语音

使用SpeechSynthesisUtterance生成语音:const utterance = new SpeechSynthesisUtterance('导航到首页'); utterance.lang = 'zh-CN'; // 设置语言 window.speechSynthesis.speak(utterance); -

控制语音播放

暂停、继续或取消语音播放:speechSynthesis.pause(); // 暂停 speechSynthesis.resume(); // 继续 speechSynthesis.cancel(); // 取消

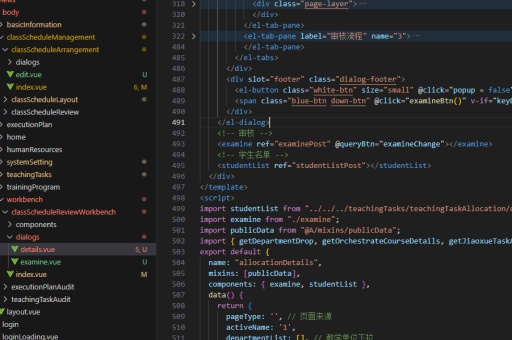

集成到Vue组件

-

封装语音服务

在src/utils/speech.js中封装语音功能:export const useSpeech = () => { const recognition = new webkitSpeechRecognition(); recognition.lang = 'zh-CN'; const startListening = (callback) => { recognition.onresult = (event) => callback(event.results[0][0].transcript); recognition.start(); }; const speak = (text) => { const utterance = new SpeechSynthesisUtterance(text); speechSynthesis.speak(utterance); }; return { startListening, speak }; }; -

组件调用示例

在Vue组件中使用封装的方法:

<template> <button @click="handleVoiceCommand">语音导航</button> </template> <script> import { useSpeech } from '@/utils/speech'; export default { setup() { const { startListening, speak } = useSpeech(); const handleVoiceCommand = () => { startListening((text) => { if (text.includes('首页')) { speak('正在跳转到首页'); router.push('/'); } }); }; return { handleVoiceCommand }; } }; </script>

注意事项

- 兼容性:Web Speech API在部分浏览器(如iOS Safari)可能受限,需检测

window.SpeechRecognition是否存在。 - 用户授权:首次使用时浏览器会请求麦克风权限,需引导用户允许。

- 性能优化:长时间监听需管理资源,避免频繁创建实例。

通过上述方法,可实现基本的语音导航功能,后续可扩展为多语言支持或复杂指令解析。